Windows配置heritrix3做网络爬虫开发实例

时间:2020-07-27 19:20:06 来源:老课堂

一、引言:

最近在忙某个商业银行的项目,需要引入外部互联网数据作为参考,作为技术选型阶段的工作,之前已经确定了中文分词工具,下一个话题就是网络爬虫的选择,目标很明确,需要下载一些财经网站的新闻信息,然后进行文本计算。记得上一次碰爬虫还是5年前,时过境迁,不知道爬虫的世界里是否有了新的崛起。比较过一些之后,初步认定Heritrix基本能够满足需要,当然肯定是需要定制的了。

二、版本选择

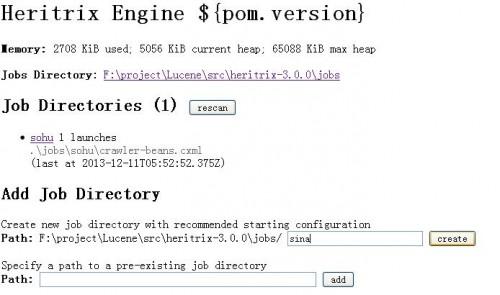

Heritrix当前版本3.1.0,安装后发现,启动任务时,Windows平台有BDBOpen的错误(具体原因不详),Linux环境没有测试。度娘了一把,没啥实质性收获,如果从源码去看,又太费时间。就换到了3.0.5,这个版本也有问题,就是创建Job时,总是提示文件夹有问题,可以选择手动创建下载任务。操作界面如下图所示:

三、配置任务-手动

1.jobs目录下新建文件夹sohu;

2.拷贝模板文件profile-crawler-beans.cxml到sohu目录

3.重命名profile-crawler-beans.cxml文件为crawler-beans.cxml

4.手动修改文件crawler-beans.cxml,设置目标网站和存储方式:

复制代码

代码如下:

# This Properties map is specified in the Java 'property list' text format

# http://java.sun.com/javase/6/docs/api/java/util/Properties.html#load%28java.io.Reader%29

metadata.operatorContactUrl=http://localhost

metadata.jobName=sohu

metadata.description=sohujingxuan

##..more?..##

# URLS HERE

http://t.sohu.com/jingxuan

http://localhost"/>

四、停用Robots检查

改造函数,禁用Robots协议检查,目的就不说了,改造方法如下:

复制代码

代码如下:

private boolean considerRobotsPreconditions(CrawlURI curi) {

// treat /robots.txt fetches specially

//++zhangzl:取消robots.txt的强制限制

return false;

//--

}

五、后续工作

1.定向下载改造:只下载目标内容,过滤无关信息。

2.自动解析改造:下载内容自动解析到指定目录,指定格式。

老课堂部分新闻及文章转载自互联网,供读者交流和学习,若有涉及作者版权等问题请及时与我们联系,以便更正、删除或按规定办理。感谢所有提供资讯的网站,欢迎各类媒体与老课堂进行文章共享合作。